Kyle Chassé

用户暂无简介

Kyle Chassé

🚨 本周是巨大的

股票刚刚暴涨,标普500指数上涨了13%,纳斯达克综合指数上涨了19%,但现在真正的考验来了,因为盈利、联邦储备决策、GDP和通胀都同时到来。

本周由微软、亚马逊、谷歌、Meta和苹果推动,这些在反弹背后的同一批公司,现在面临压力,必须交出成绩,因为人工智能支出、利润率和指引成为焦点。

盈利表现强劲,81%的公司超出预期,利润增长了16%,但现在预期很高,市场希望看到卓越的业绩,而不仅仅是稳健的表现。

与此同时,降息被推迟,地缘政治风险依然存在,这可能是杰罗姆·鲍威尔领导的最后一次会议。

底线:反弹现在取决于大型科技公司能否交出答卷,如果他们未能达标,市场就会暴露风险。

股票刚刚暴涨,标普500指数上涨了13%,纳斯达克综合指数上涨了19%,但现在真正的考验来了,因为盈利、联邦储备决策、GDP和通胀都同时到来。

本周由微软、亚马逊、谷歌、Meta和苹果推动,这些在反弹背后的同一批公司,现在面临压力,必须交出成绩,因为人工智能支出、利润率和指引成为焦点。

盈利表现强劲,81%的公司超出预期,利润增长了16%,但现在预期很高,市场希望看到卓越的业绩,而不仅仅是稳健的表现。

与此同时,降息被推迟,地缘政治风险依然存在,这可能是杰罗姆·鲍威尔领导的最后一次会议。

底线:反弹现在取决于大型科技公司能否交出答卷,如果他们未能达标,市场就会暴露风险。

查看原文

- 赞赏

- 点赞

- 评论

- 转发

- 分享

🚨 事情又来了……

油价从70涨到118,现在在96左右。CPI跃升至3.3%,核心PCE为3.1%。增长放缓,通胀上升,美联储利率维持在3.5%到3.75%之间。滞胀风险正在增加。国际货币基金组织预测增长3.1%,通胀4.4%。

比特币表面看起来疲软,徘徊在75K到78K,屡次被拒绝。

但在底层,资金持续为负达46天,鲸鱼在一个月内累计了27万BTC,交易所余额达到7年最低点。

Polymarket给出79K以上的概率,且有39%的可能性。

底线:宏观环境复杂,比特币在区间震荡,但聪明的钱在不断积累。五月可能是关键时刻。

油价从70涨到118,现在在96左右。CPI跃升至3.3%,核心PCE为3.1%。增长放缓,通胀上升,美联储利率维持在3.5%到3.75%之间。滞胀风险正在增加。国际货币基金组织预测增长3.1%,通胀4.4%。

比特币表面看起来疲软,徘徊在75K到78K,屡次被拒绝。

但在底层,资金持续为负达46天,鲸鱼在一个月内累计了27万BTC,交易所余额达到7年最低点。

Polymarket给出79K以上的概率,且有39%的可能性。

底线:宏观环境复杂,比特币在区间震荡,但聪明的钱在不断积累。五月可能是关键时刻。

BTC1.17%

- 赞赏

- 点赞

- 评论

- 转发

- 分享

霍尔木兹海峡的封锁切断了全球海运硫磺供应的50%。

中国自2026年5月起禁止硫酸出口。

智利的硫酸价格自2月以来上涨了57%。

一些铜生产商的库存不足30天。

智利每年进口100万吨以上的中国硫酸,因为其20%的铜产量依赖于它。

刚果(金)供应全球15%的铜。他们的酸料供应刚刚被切断。

没有硫酸就没有铜矿开采。

没有铜就没有数据中心、没有电动汽车、没有电网基础设施。

计时从5月开始。

查看原文中国自2026年5月起禁止硫酸出口。

智利的硫酸价格自2月以来上涨了57%。

一些铜生产商的库存不足30天。

智利每年进口100万吨以上的中国硫酸,因为其20%的铜产量依赖于它。

刚果(金)供应全球15%的铜。他们的酸料供应刚刚被切断。

没有硫酸就没有铜矿开采。

没有铜就没有数据中心、没有电动汽车、没有电网基础设施。

计时从5月开始。

- 赞赏

- 点赞

- 1

- 转发

- 分享

smokey26:

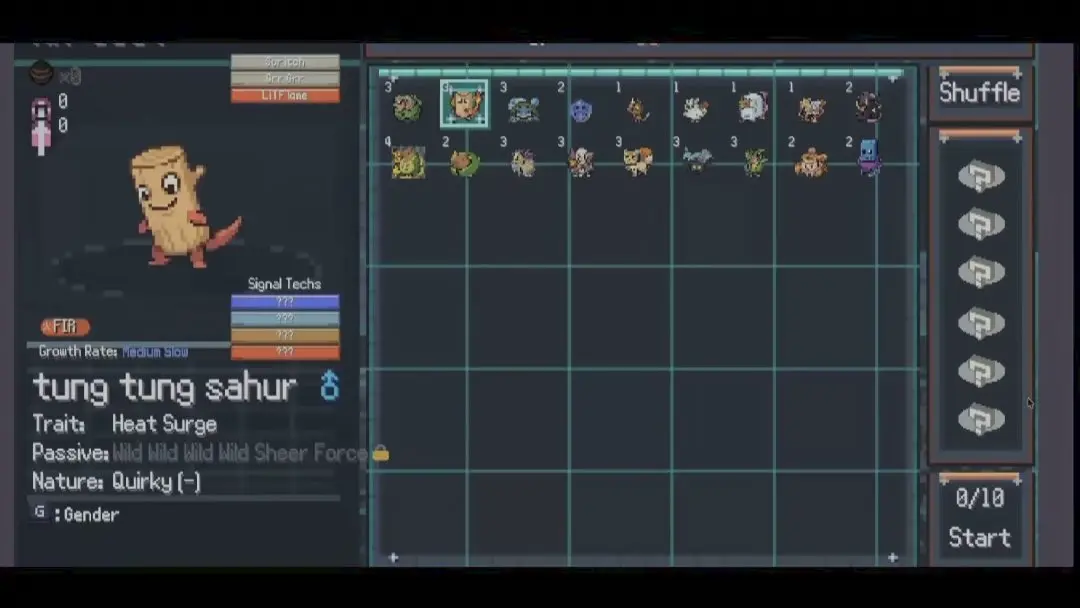

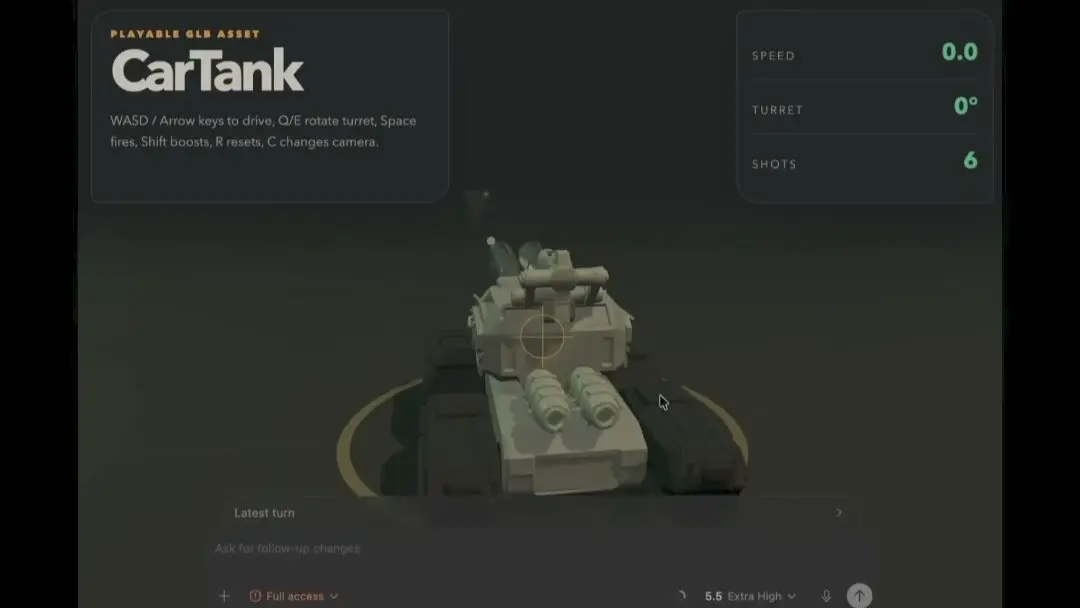

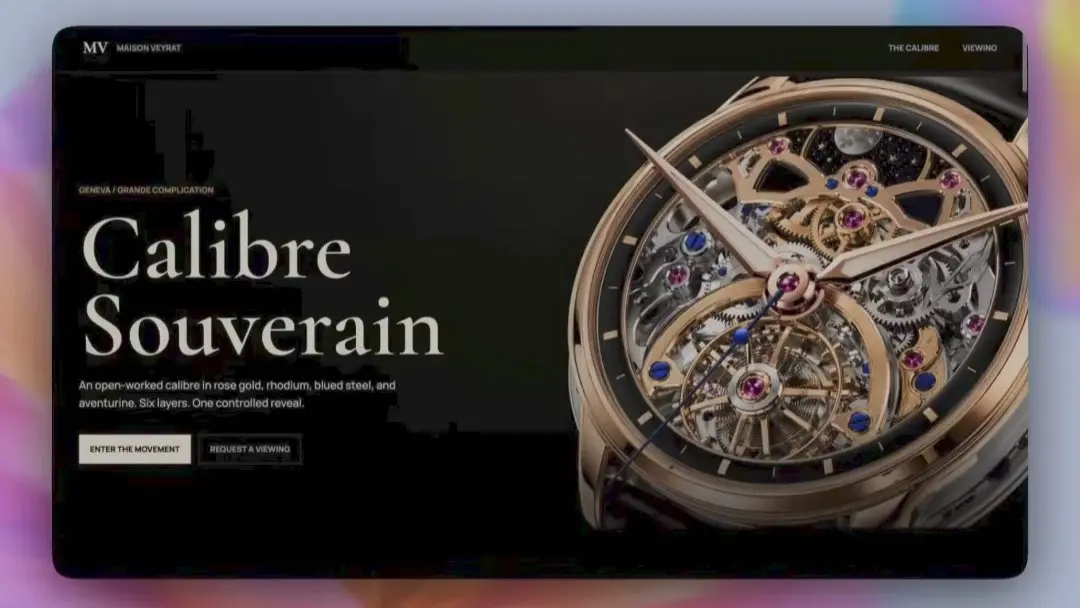

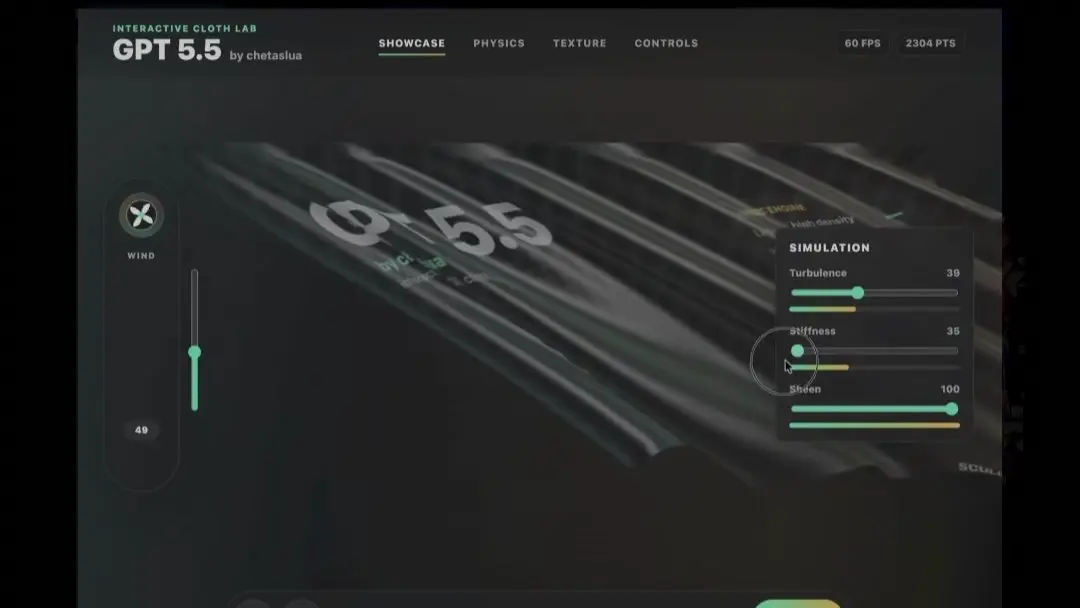

当市场看涨时,一切都像牛市。保持冷静,等待突破确认再入场,不要被FOMO冲昏头脑。GPT-5.5 发布,人们构建了:

- 一个完整的宝可梦式角色扮演游戏

- 可以从图片生成可玩的3D资产

- 豪华的网页设计

- 实时布料物理引擎

全部在几天内完成。单人

等大多数人开始正确使用AI时,已经太迟了。

不要被甩在后面。

查看原文- 一个完整的宝可梦式角色扮演游戏

- 可以从图片生成可玩的3D资产

- 豪华的网页设计

- 实时布料物理引擎

全部在几天内完成。单人

等大多数人开始正确使用AI时,已经太迟了。

不要被甩在后面。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

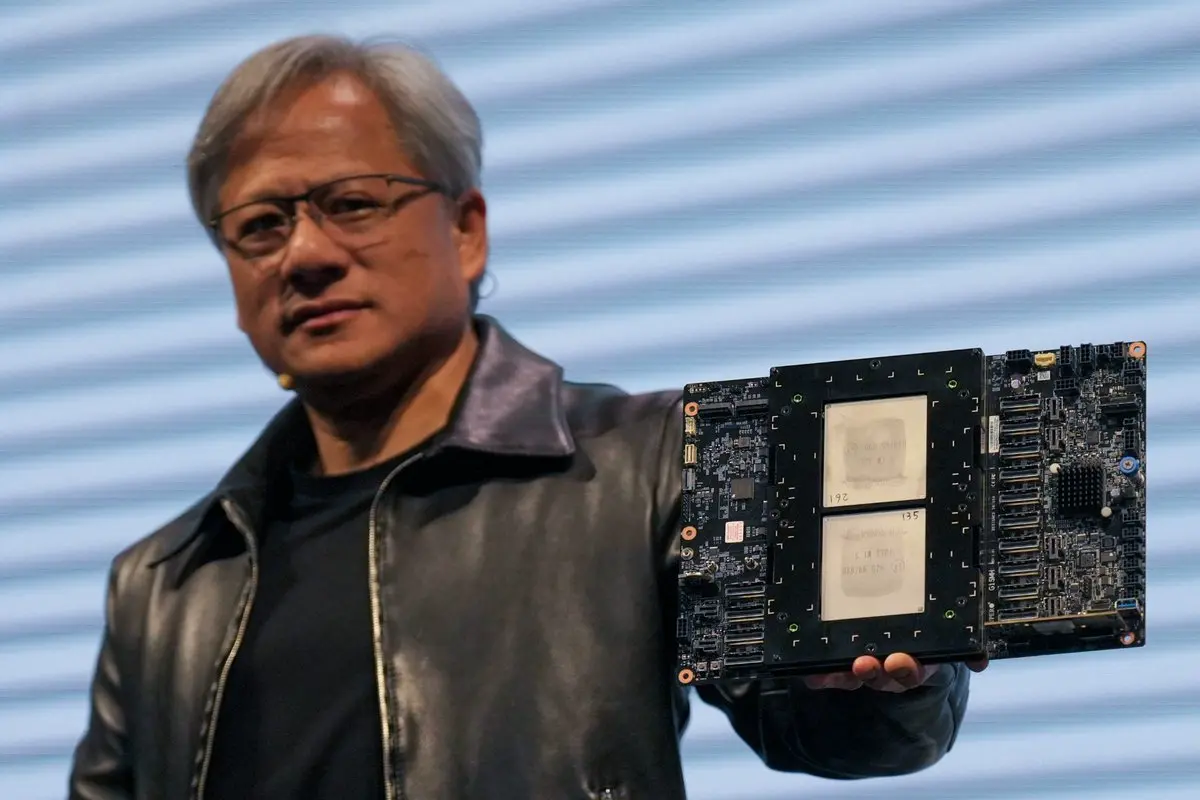

AI 甚至还没有开始它的真正行动。

到2030年,全球AI基础设施支出预计将达到50000亿亿到14000亿亿美元。这些资金已经开始体现在超大规模云服务提供商的预算中。

英伟达刚刚收盘创下历史新高。别忘了英特尔的繁荣也是如此。

GPU用于训练模型。

CPU运行系统。

台积电生产两者。

然后还有千瓦时。

美国公用事业公司在2030年前分配了大约1.4万亿美元用于升级电网。驱动力是来自AI的数据中心负载。

他们实际上是在为此建设。

赢家不是单一公司,而是供应链。

计算寡头垄断正在实时形成。

到2030年,全球AI基础设施支出预计将达到50000亿亿到14000亿亿美元。这些资金已经开始体现在超大规模云服务提供商的预算中。

英伟达刚刚收盘创下历史新高。别忘了英特尔的繁荣也是如此。

GPU用于训练模型。

CPU运行系统。

台积电生产两者。

然后还有千瓦时。

美国公用事业公司在2030年前分配了大约1.4万亿美元用于升级电网。驱动力是来自AI的数据中心负载。

他们实际上是在为此建设。

赢家不是单一公司,而是供应链。

计算寡头垄断正在实时形成。

查看原文

- 赞赏

- 点赞

- 评论

- 转发

- 分享

英特尔刚刚走出了抛物线。

美国政府持有英特尔10%的股份,几周后,英伟达增加了$5B 投资,使股价从那些水平大约翻了三倍。

你为什么要关心?

这不是一次普通的市场波动,而是协调的资本和政策将半导体视为关键基础设施。

开始关注哪些公司获得战略支持,因为那里的超额回报可能会出现。

查看原文美国政府持有英特尔10%的股份,几周后,英伟达增加了$5B 投资,使股价从那些水平大约翻了三倍。

你为什么要关心?

这不是一次普通的市场波动,而是协调的资本和政策将半导体视为关键基础设施。

开始关注哪些公司获得战略支持,因为那里的超额回报可能会出现。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

🚨 人工智能是一个没有控制的4.8T系统???

在“面向社会发展的AI”(AI for Social Development)数字世界大会上,杰弗里·辛顿警告称:人工智能正在失去引导地加速扩张。

联合国贸易和发展会议预测,到2033年,规模将从189B增长到4.8T。

控制权高度集中。

据多琳·博格丹-马丁介绍,全球北方的采用速度是全球南方的2倍。

风险也在扩张。

玛丽亚·雷萨指出,叙事战正在打击信息,信任也在被侵蚀。

而解决方案是一场艰难的“上坡战”:

1. 计算能力的接入必须扩大

2. 数据治理必须可审计

3. 模型部署需要明确的责任归属

4. 标准必须是全球性的,而不是碎片化的

联合国正在推动协调。

但究竟多少才算“过多”?

查看原文在“面向社会发展的AI”(AI for Social Development)数字世界大会上,杰弗里·辛顿警告称:人工智能正在失去引导地加速扩张。

联合国贸易和发展会议预测,到2033年,规模将从189B增长到4.8T。

控制权高度集中。

据多琳·博格丹-马丁介绍,全球北方的采用速度是全球南方的2倍。

风险也在扩张。

玛丽亚·雷萨指出,叙事战正在打击信息,信任也在被侵蚀。

而解决方案是一场艰难的“上坡战”:

1. 计算能力的接入必须扩大

2. 数据治理必须可审计

3. 模型部署需要明确的责任归属

4. 标准必须是全球性的,而不是碎片化的

联合国正在推动协调。

但究竟多少才算“过多”?

- 赞赏

- 点赞

- 评论

- 转发

- 分享

🚨 加密货币刚进入一个新时代

在2019年,没有规则意味着没有前进的道路。

今天?

稳定币法律已存在。

SEC翻转了。

银行可以参与。

Libra在不确定中死去。

X正走向清晰。

这就是转变。

现在就看:

查看原文在2019年,没有规则意味着没有前进的道路。

今天?

稳定币法律已存在。

SEC翻转了。

银行可以参与。

Libra在不确定中死去。

X正走向清晰。

这就是转变。

现在就看:

- 赞赏

- 点赞

- 评论

- 转发

- 分享

🚨 人工智能分布并不均匀。

普华永道(PwC)数据显示:有20%的公司获取了人工智能价值的74%。

约翰迪尔通过使用人工智能,节省了59%的除草剂。

温德姆通过使用人工智能,在每次审查中可节省40-80小时。

一家医疗保健公司使用人工智能,使员工获取数据的难度降低了50%。

这只是普华永道正在协助的部分。

人工智能正在幕后更快地推进。

它正在打造那些让赚钱变得更容易、更快的系统。

你有没有正确使用它?

来源:

查看原文普华永道(PwC)数据显示:有20%的公司获取了人工智能价值的74%。

约翰迪尔通过使用人工智能,节省了59%的除草剂。

温德姆通过使用人工智能,在每次审查中可节省40-80小时。

一家医疗保健公司使用人工智能,使员工获取数据的难度降低了50%。

这只是普华永道正在协助的部分。

人工智能正在幕后更快地推进。

它正在打造那些让赚钱变得更容易、更快的系统。

你有没有正确使用它?

来源:

- 赞赏

- 点赞

- 评论

- 转发

- 分享

三条航道被封锁,全球贸易正面临史上最大挑战。

而大多数人完全不知道这正在发生。

你拥有的所有物品的90%都是通过三条狭窄的海峡之一的货船到达的。

而现在?

这三条海峡同时受到威胁。

这是前所未有的。

从未发生过。

首先:霍尔木兹海峡。

这是大家都知道的那一个。

全球20%的石油。

50年来对全球能源的最大干扰。

布伦特原油价格达到$103 每桶。

第二:巴布-曼德布海峡。

苏伊士运河的门户。

马士基。哈帕克-洛伊德。中远海运。

每一家主要的航运公司都在绕非洲重新规划路线。

增加了数周的时间和数千的成本。

第三个。

而这个没人提起。

马六甲海峡。

全球贸易的40%。

每年3.5万亿美元。

如此狭窄,一艘失效的超级油轮就能封锁整个通道。

中国80%的石油都通过这里。

他们字面上称之为“马六甲困境”。

而海盗活动也达到了19年来的最高点。

而巡逻它的战舰被调走了。

石油。食品。化肥。半导体。

全部都在变慢。

全部都变得更贵。

三条海峡。

一个时刻。

局势变得越来越疯狂。

查看原文而大多数人完全不知道这正在发生。

你拥有的所有物品的90%都是通过三条狭窄的海峡之一的货船到达的。

而现在?

这三条海峡同时受到威胁。

这是前所未有的。

从未发生过。

首先:霍尔木兹海峡。

这是大家都知道的那一个。

全球20%的石油。

50年来对全球能源的最大干扰。

布伦特原油价格达到$103 每桶。

第二:巴布-曼德布海峡。

苏伊士运河的门户。

马士基。哈帕克-洛伊德。中远海运。

每一家主要的航运公司都在绕非洲重新规划路线。

增加了数周的时间和数千的成本。

第三个。

而这个没人提起。

马六甲海峡。

全球贸易的40%。

每年3.5万亿美元。

如此狭窄,一艘失效的超级油轮就能封锁整个通道。

中国80%的石油都通过这里。

他们字面上称之为“马六甲困境”。

而海盗活动也达到了19年来的最高点。

而巡逻它的战舰被调走了。

石油。食品。化肥。半导体。

全部都在变慢。

全部都变得更贵。

三条海峡。

一个时刻。

局势变得越来越疯狂。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

🔥 AI 的发展速度正在超越历史上任何一项技术。

采用率正在压过个人电脑和互联网,而尽管算力支出规模巨大,收入仍在飙升。

甚至 SnP500 指数的 45% 都是 AI。

Anthropic 在性能方面领先,xAI、谷歌和OpenAI 紧随其后,而 DeepSeek 和阿里巴巴也不远。

与此同时,Geoffrey Hinton 正在警告:我们正在打造一个速度非常快、却缺乏控制的系统。

这不仅仅是能力。

而是速度。

查看原文采用率正在压过个人电脑和互联网,而尽管算力支出规模巨大,收入仍在飙升。

甚至 SnP500 指数的 45% 都是 AI。

Anthropic 在性能方面领先,xAI、谷歌和OpenAI 紧随其后,而 DeepSeek 和阿里巴巴也不远。

与此同时,Geoffrey Hinton 正在警告:我们正在打造一个速度非常快、却缺乏控制的系统。

这不仅仅是能力。

而是速度。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

- 赞赏

- 1

- 评论

- 转发

- 分享

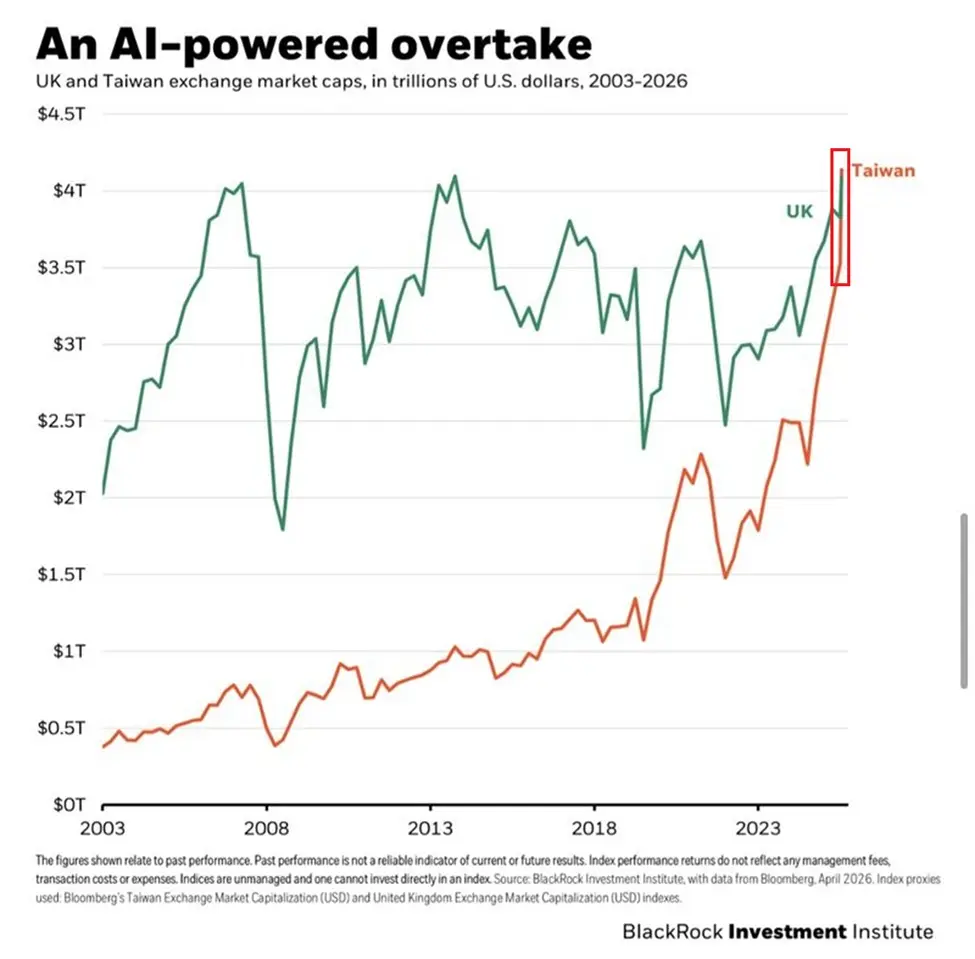

🇹🇼 台湾刚刚在市值上超过了英国。

4.14万亿美元对比4.09万亿美元,背后是AI需求涌入半导体,而台积电位于其中的核心位置。

芯片依靠极致精密的制造流程:先进光刻、分层沉积、蚀刻以及封装,全部都依赖稀有设备和漫长的供应链。

AI需求的爆发速度比产能规模化所能跟上的速度还要快,而晶圆厂的建设需要数年时间,并且投入数十亿美元。

如果供给能跟得上,AI的采用将在每个行业加速。

如果不能,短缺、更高成本和瓶颈将会让从数据中心到消费类科技的各个领域都放慢发展。

查看原文4.14万亿美元对比4.09万亿美元,背后是AI需求涌入半导体,而台积电位于其中的核心位置。

芯片依靠极致精密的制造流程:先进光刻、分层沉积、蚀刻以及封装,全部都依赖稀有设备和漫长的供应链。

AI需求的爆发速度比产能规模化所能跟上的速度还要快,而晶圆厂的建设需要数年时间,并且投入数十亿美元。

如果供给能跟得上,AI的采用将在每个行业加速。

如果不能,短缺、更高成本和瓶颈将会让从数据中心到消费类科技的各个领域都放慢发展。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

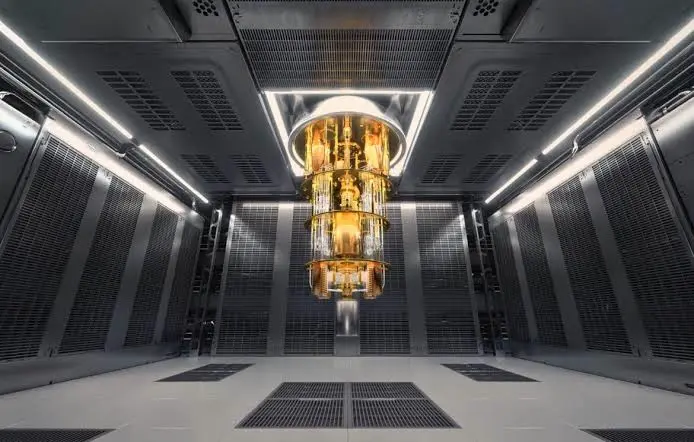

🚨 人工智能正在让量子变得实用。

伦敦大学学院的一个团队刚刚展示了一种混合方法,量子计算增强了人工智能,而不是取代经典系统。

他们没有在量子硬件上运行完整的模拟,而是使用量子处理器从混沌系统中提取稳定的统计模式,并将这些洞察输入到传统的人工智能模型中。

结果是在使用数百倍更少内存的同时,准确率提高了大约20%,这是一种有意义的跃升,而不是边际的提升。

这很重要,因为像气候、流体动力学和药物发现这样的混沌系统,长期以来一直因累积误差而突破不了经典模型。

量子计算帮助识别潜在的结构,而人工智能则扩展预测能力。

大多数人仍在等待量子取代经典计算,但这表明真正的前进路径是使用在具有明显优势的领域的量子混合系统。

这才是量子现在开始变得具有商业相关性,而不是十年之后。

查看原文伦敦大学学院的一个团队刚刚展示了一种混合方法,量子计算增强了人工智能,而不是取代经典系统。

他们没有在量子硬件上运行完整的模拟,而是使用量子处理器从混沌系统中提取稳定的统计模式,并将这些洞察输入到传统的人工智能模型中。

结果是在使用数百倍更少内存的同时,准确率提高了大约20%,这是一种有意义的跃升,而不是边际的提升。

这很重要,因为像气候、流体动力学和药物发现这样的混沌系统,长期以来一直因累积误差而突破不了经典模型。

量子计算帮助识别潜在的结构,而人工智能则扩展预测能力。

大多数人仍在等待量子取代经典计算,但这表明真正的前进路径是使用在具有明显优势的领域的量子混合系统。

这才是量子现在开始变得具有商业相关性,而不是十年之后。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

🚨 这个市场并不像看起来那么平静。

市场从停火延长中反弹。不要把宽慰与强势混淆。

霍尔木兹仍然关闭。石油供应正在收紧。通胀依然顽固。增长正在放缓。

几乎没有任何事情被完全反映在价格中,目前也没有什么是确定的。

这就是为什么长期投资仍然是更明智的交易。

查看原文市场从停火延长中反弹。不要把宽慰与强势混淆。

霍尔木兹仍然关闭。石油供应正在收紧。通胀依然顽固。增长正在放缓。

几乎没有任何事情被完全反映在价格中,目前也没有什么是确定的。

这就是为什么长期投资仍然是更明智的交易。

- 赞赏

- 1

- 1

- 转发

- 分享

NexaCrypto :

LFG 🔥- 赞赏

- 点赞

- 评论

- 转发

- 分享

好的。下面是修订后的版本——不使用破折号:

听证会已经发生了。

4月21日,凯文·沃什坐在参议院银行委员会面前。那一部分已经结束。现在重要的是围绕它的一切。

沃什不仅对加密货币友好。他还在加密货币领域暴露无遗。他的披露显示了他在 DeFi、L1s、预测市场以及比特币基础设施方面的真实立场。这是新的。我们从未有过这样接近正轨的美联储主席提名人。

他甚至已经直接说出口:比特币很重要。它不是噱头,而是一种信号。也就是对政策制定者的一个制衡。

仅这一点就足以改变讨论。

但政治仍然是瓶颈。

参议员汤姆·蒂利斯正在坚守阵地。在杰罗姆·鲍威尔的调查结束之前,不会对沃什投票。这不是噪音,而是路径。如果蒂利斯不让步,提名也就不会推进。

与此同时,《CLARITY 法案》刚刚被挪后。不是被否决,而是被延迟。沃什听证会夺走了关注度,现在时间表又一次滑动。

所以放大来看:

加密货币终于在美联储的讨论中有了一席之地。

但门槛仍然是政治。

真正的风险在于时机,而非意识形态。

关注蒂利斯。

听证会已经发生了。

4月21日,凯文·沃什坐在参议院银行委员会面前。那一部分已经结束。现在重要的是围绕它的一切。

沃什不仅对加密货币友好。他还在加密货币领域暴露无遗。他的披露显示了他在 DeFi、L1s、预测市场以及比特币基础设施方面的真实立场。这是新的。我们从未有过这样接近正轨的美联储主席提名人。

他甚至已经直接说出口:比特币很重要。它不是噱头,而是一种信号。也就是对政策制定者的一个制衡。

仅这一点就足以改变讨论。

但政治仍然是瓶颈。

参议员汤姆·蒂利斯正在坚守阵地。在杰罗姆·鲍威尔的调查结束之前,不会对沃什投票。这不是噪音,而是路径。如果蒂利斯不让步,提名也就不会推进。

与此同时,《CLARITY 法案》刚刚被挪后。不是被否决,而是被延迟。沃什听证会夺走了关注度,现在时间表又一次滑动。

所以放大来看:

加密货币终于在美联储的讨论中有了一席之地。

但门槛仍然是政治。

真正的风险在于时机,而非意识形态。

关注蒂利斯。

BTC1.17%

- 赞赏

- 点赞

- 评论

- 转发

- 分享

🚨 DEFI刚刚反击

Arbitrum刚刚冻结了$71M 来自Kelp DAO黑客的资金。

数小时内大约锁定了30,766 ETH。

在四月超过6亿美元的漏洞之后,这显示出DeFi可以采取行动,而不仅仅是反应。

治理正成为一个真正的防御层。

当其他人专注于损失时,基础设施变得更加强大。

Arbitrum刚刚冻结了$71M 来自Kelp DAO黑客的资金。

数小时内大约锁定了30,766 ETH。

在四月超过6亿美元的漏洞之后,这显示出DeFi可以采取行动,而不仅仅是反应。

治理正成为一个真正的防御层。

当其他人专注于损失时,基础设施变得更加强大。

ETH2.24%

- 赞赏

- 1

- 1

- 转发

- 分享

EmpressPhae:

感谢上帝SUI 正在悄然成为代理经济的基础设施

RedotPay 刚刚将 SUI 与原生 USDC 集成,用于全球支付。

7M+ 用户。

即时、低成本、7×24 小时结算。

这正是 AI agents 所需要的,能够进行自主交易。

当所有人都在争论监管时,Sui 正在交付真正的基础设施。

大多数人还在沉睡。

RedotPay 刚刚将 SUI 与原生 USDC 集成,用于全球支付。

7M+ 用户。

即时、低成本、7×24 小时结算。

这正是 AI agents 所需要的,能够进行自主交易。

当所有人都在争论监管时,Sui 正在交付真正的基础设施。

大多数人还在沉睡。

SUI1.28%

- 赞赏

- 点赞

- 评论

- 转发

- 分享

热门话题

查看更多25.79万 热度

31.22万 热度

10.93万 热度

49.89万 热度

5.69万 热度

置顶

🔥 WCTC S8 全球交易赛正式开赛!

8,000,000 USDT 超级奖池解锁开启

🏆 团队赛:上半场正式开启,预报名阶段 5,500+ 战队现已集结

交易量收益额双重比拼,解锁上半场 1,800,000 USDT 奖池

🏆 个人赛:现货、合约、TradFi、ETF、闪兑、跟单齐上阵

全场交易量比拼,瓜分 2,000,000 USDT 奖池

🏆 王者 PK 赛:零门槛参与,实时匹配享受战斗快感

收益率即时 PK,瓜分 1,600,000 USDT 奖池

活动时间:2026 年 4月 23 日 16:00:00 -2026 年 5 月 20 日 15:59:59 UTC+8

⬇️ 立即参与:https://www.gate.com/competition/wctc-s8

#WCTCS8🎁 积分换豪礼!成长值第 1️⃣ 8️⃣ 期社区抽奖狂欢开启!

新老用户 100% 中奖,完成日常任务即可参与抽奖!

👉 https://www.gate.com/activities/pointprize?now_period=18

🌟 如何参与?

1️⃣ 进入【广场】个人主页,点击头像旁积分标识进入【社区中心】

2️⃣ 完成发帖、评论、点赞、发言等广场或热聊任务赚取成长值

🎁 每满 300 积分即可抽奖 1 次,MacBook Air M5、Gate 13 周年礼盒、VIP 体验卡等您来拿!

🔥 本期门槛再降低:仅需完成 20U 现货交易,即可获得发奖资格!

详情 👉 https://www.gate.com/announcements/article/5085410,000 USDT 悬赏,寻找跟单金牌星探!🕵️

挖掘顶级带单员,赢取高额跟单体验金!

立即参与:https://www.gate.com/campaigns/4624

🎁 三大活动,奖金叠满:

1️⃣ 慧眼识英:发帖推荐带单员,分享跟单体验,抽 100 位送 30 USDT!

2️⃣ 强力应援:晒出你的跟单截图,为大神打 Call,抽 120 位送 50 USDT!

3️⃣ 社交达人:同步至 X/Twitter,凭流量赢取 100 USDT!

📍 标签: #跟单金牌星探 #GateCopyTrading

⏰ 限时: 4/22 16:00 - 5/10 16:00 (UTC+8)

详情:https://www.gate.com/announcements/article/50848十三载风雨同行,您是 Gate 最珍贵的见证者。分享您的故事,瓜分重磅周年豪礼!

参与方式

1️⃣ 带 #Gate13周年 和相应主题标签,在 13 周年留言板或广场发帖

2️⃣ 分享您与 Gate 的故事、送上祝福,或畅想未来 13 年

13 周年定制礼盒、红牛模型、大额仓位体验券等您来拿!

13周年庆留言板 👉️ https://www.gate.com/activities/13th-anniversary

Gate 广场 👉️ https://www.gate.com/post

13 年成长,感谢有您。您的故事,我们期待聆听!

详情:https://www.gate.com/announcements/article/50694